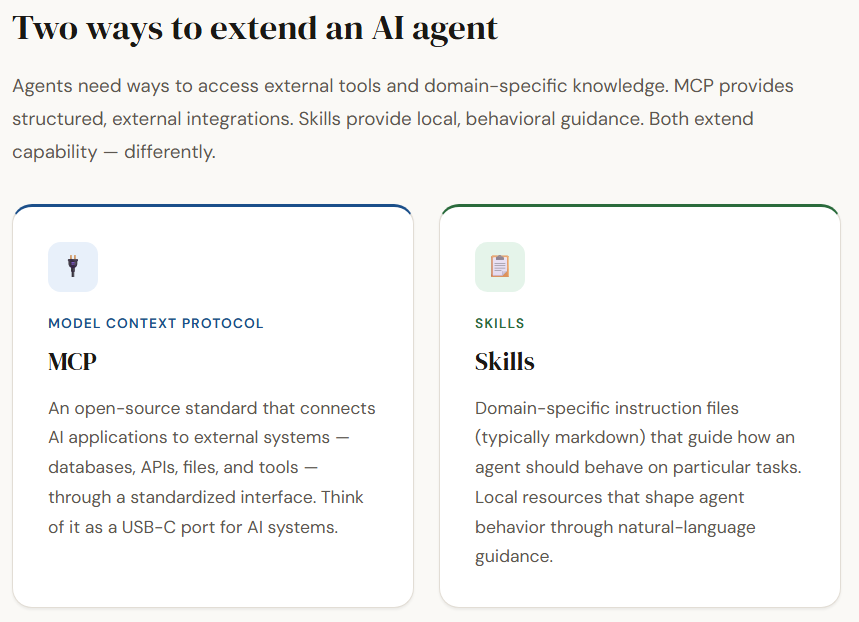

Nos últimos tempos, muitos desenvolvimentos no ecossistema de agentes concentraram-se em permitir que os agentes de IA interajam com ferramentas externas e acessem conhecimentos específicos de domínio de forma mais eficaz. Duas abordagens comuns que surgiram são habilidades e MCP. Embora possam parecer semelhantes à primeira vista, eles diferem na forma como são configurados, como executam as tarefas e no público para o qual foram projetados. Neste artigo, exploraremos o que cada abordagem oferece e examinaremos suas principais diferenças.

Protocolo de Contexto do Modelo (MCP)

Protocolo de Contexto do Modelo (MCP) é um padrão de código aberto que permite que aplicativos de IA se conectem a sistemas externos, como bancos de dados, arquivos locais, APIs ou ferramentas especializadas. Ele amplia as capacidades de grandes modelos de linguagem, expondo ferramentas, recursos (contexto estruturado como documentos ou arquivos), e avisos que o modelo pode usar durante o raciocínio. Em termos simples, o MCP atua como uma interface padronizada – semelhante a como um Porta USB-C conecta dispositivos – facilitando a interação de sistemas de IA como ChatGPT ou Claude com dados e serviços externos.

Embora os servidores MCP não sejam extremamente difíceis de configurar, eles são projetados principalmente para desenvolvedores que se sentem confortáveis com conceitos como autenticação, transportes e interfaces de linha de comando. Uma vez configurado, o MCP permite interações estruturadas e altamente previsíveis. Cada ferramenta normalmente executa uma tarefa específica e retorna um resultado determinístico com a mesma entrada, tornando o MCP confiável para operações precisas, como web scraping, consultas de banco de dados ou chamadas de API.

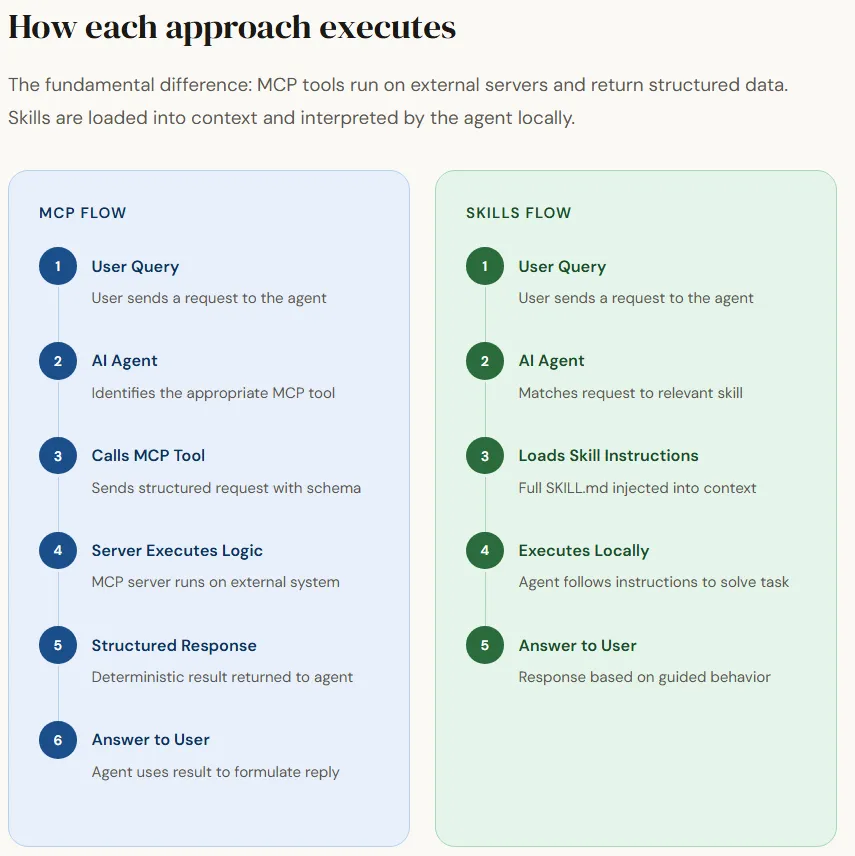

Fluxo MCP típico

Consulta do usuário → Agente AI → Chama a ferramenta MCP → Servidor MCP executa lógica → Retorna resposta estruturada → Agente usa resultado para responder ao usuário

Limitações do MCP

Embora o MCP forneça uma maneira poderosa para os agentes interagirem com sistemas externos, ele também introduz diversas limitações no contexto dos fluxos de trabalho dos agentes de IA. Um desafio importante é a escalabilidade e a descoberta da ferramenta. À medida que o número de ferramentas MCP aumenta, o agente deve confiar nos nomes e nas descrições das ferramentas para identificar a correta, ao mesmo tempo que adere ao esquema de entrada específico de cada ferramenta.

Isso pode dificultar a seleção de ferramentas e levou ao desenvolvimento de soluções como gateways MCP ou camadas de descoberta para ajudar os agentes a navegar em grandes ecossistemas de ferramentas. Além disso, se as ferramentas forem mal projetadas, poderão retornar respostas excessivamente grandes, o que pode sobrecarregar a janela de contexto do agente e reduzir a eficiência do raciocínio.

Outra limitação importante é a latência e a sobrecarga operacional. Como as ferramentas MCP normalmente envolvem chamadas de rede para serviços externos, cada invocação introduz atraso adicional em comparação com operações locais. Isso pode desacelerar os fluxos de trabalho do agente em várias etapas, onde diversas ferramentas precisam ser chamadas sequencialmente.

Além disso, as interações MCP exigem configurações estruturadas de servidores e comunicação baseada em sessão, o que adiciona complexidade à implantação e manutenção. Embora essas compensações sejam muitas vezes aceitáveis no acesso a dados ou serviços externos, elas podem se tornar ineficientes para tarefas que, de outra forma, poderiam ser realizadas localmente no agente.

Habilidades

Habilidades são instruções específicas do domínio que orientam como um agente de IA deve se comportar ao lidar com tarefas específicas. Ao contrário das ferramentas MCP, que dependem de serviços externos, as competências são normalmente recursos locais—geralmente escritos em arquivos markdown—que contêm instruções estruturadas, referências e, às vezes, trechos de código.

Quando uma solicitação do usuário corresponde à descrição de uma habilidade, o agente carrega as instruções relevantes em seu contexto e as segue enquanto resolve a tarefa. Dessa forma, as habilidades funcionam como um camada comportamentalmoldando como o agente aborda problemas específicos usando orientação em linguagem natural em vez de chamadas de ferramentas externas.

Uma das principais vantagens das competências é a sua simplicidade e flexibilidade. Eles exigem configuração mínima, podem ser facilmente personalizados com linguagem natural e são armazenados localmente em diretórios, em vez de servidores externos. Os agentes geralmente carregam apenas o nome e a descrição de cada habilidade na inicialização e, quando uma solicitação corresponde a uma habilidade, as instruções completas são trazidas para o contexto e executadas. Essa abordagem mantém o agente eficiente e ainda permite acesso a orientações detalhadas específicas de tarefas quando necessário.

Fluxo de trabalho de habilidades típico

Consulta do usuário → Agente de IA → Corresponde à habilidade relevante → Carrega as instruções da habilidade no contexto → Executa a tarefa seguindo as instruções → Retorna a resposta ao usuário

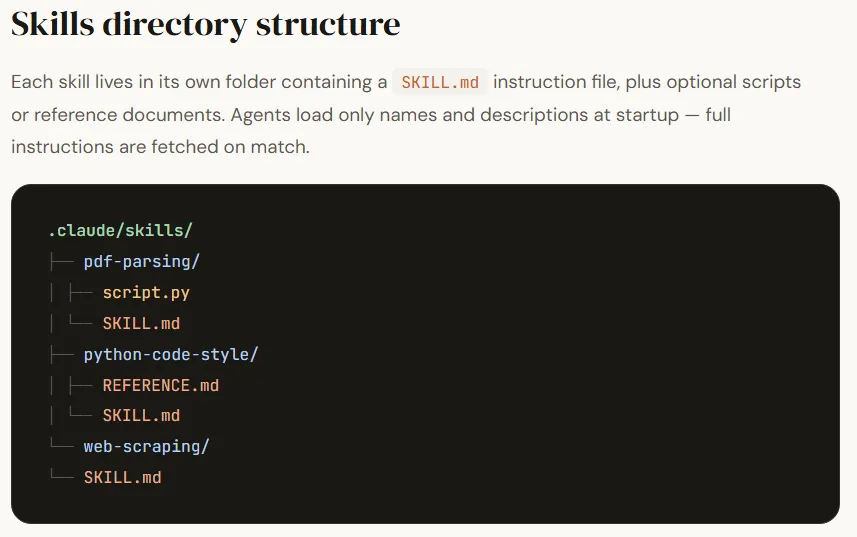

Estrutura do diretório de habilidades

Um típico estrutura de diretório de habilidades organiza cada habilidade em sua própria pasta, facilitando ao agente descobri-las e ativá-las quando necessário. Cada pasta geralmente contém um arquivo de instruções principal junto com scripts opcionais ou documentos de referência que suportam a tarefa.

| .claude/habilidades ├── análise de PDF │ ├──script.py │ └── HABILIDADE.md ├── estilo de código python │ ├── REFERÊNCIA.md │ └── HABILIDADE.md └── web scraping └── HABILIDADE.md |

Nesta estrutura, cada habilidade contém um HABILIDADE.md arquivo, que é o principal documento de instruções que informa ao agente como executar uma tarefa específica. O arquivo geralmente inclui metadados como o nome e a descrição da habilidade, seguidos de instruções passo a passo que o agente deve seguir quando a habilidade for ativada. Arquivos adicionais como scripts (script.py) ou documentos de referência (REFERENCE.md) também podem ser incluídos para fornecer utilitários de código ou orientação estendida.

Limitações de habilidades

Embora as habilidades ofereçam flexibilidade e fácil personalização, elas também apresentam certas limitações quando usadas em fluxos de trabalho de agentes de IA. O principal desafio advém do facto de as competências serem escritas em instruções de linguagem natural e não em código determinístico.

Isso significa que o agente deve interpretar como executar as instruções, o que às vezes pode levar a interpretações errôneas, execução inconsistente ou alucinações. Mesmo que a mesma habilidade seja acionada várias vezes, o resultado pode variar dependendo de como o LLM raciocina através das instruções.

Outra limitação é que as habilidades impõem uma maior carga de raciocínio ao agente. O agente não deve apenas decidir qual habilidade usar e quando, mas também determinar como executar as instruções dentro da habilidade. Isso aumenta as chances de falha se as instruções forem ambíguas ou se a tarefa exigir uma execução precisa.

Além disso, como as habilidades dependem da injeção de contexto, carregar habilidades múltiplas ou complexas pode consumir um espaço de contexto valioso e afetar o desempenho em conversas mais longas. Como resultado, embora as competências sejam altamente flexíveis para orientar o comportamento, podem ser menos fiáveis do que as ferramentas estruturadas quando as tarefas exigem uma execução consistente e determinística.

MCP vs Habilidades

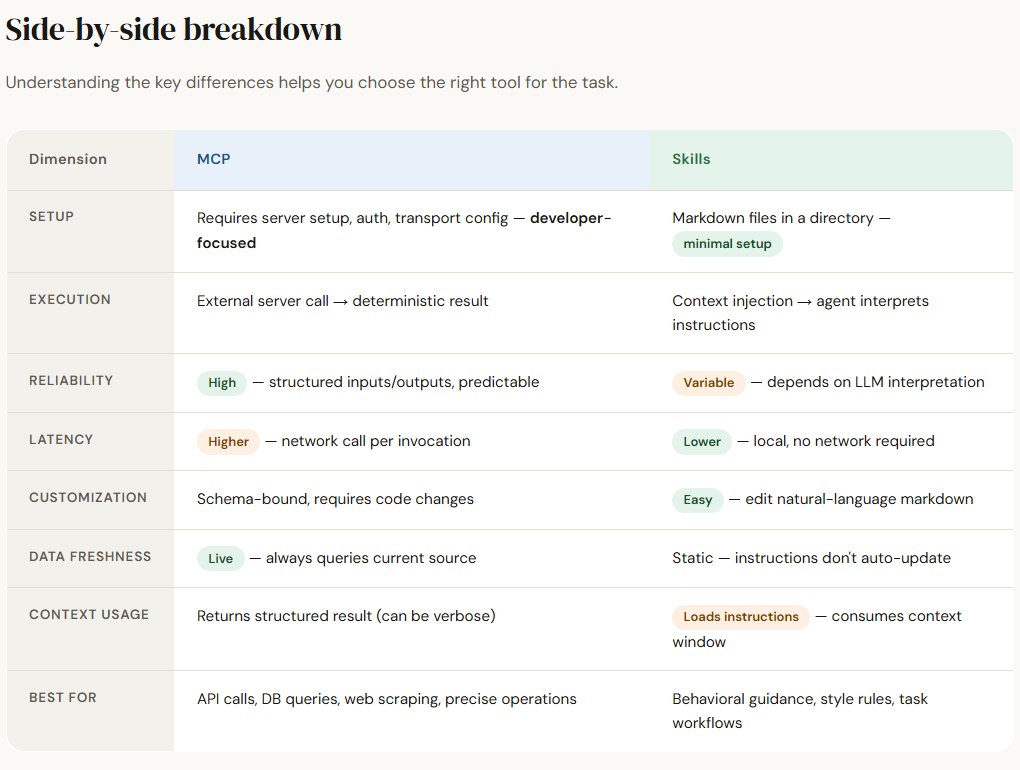

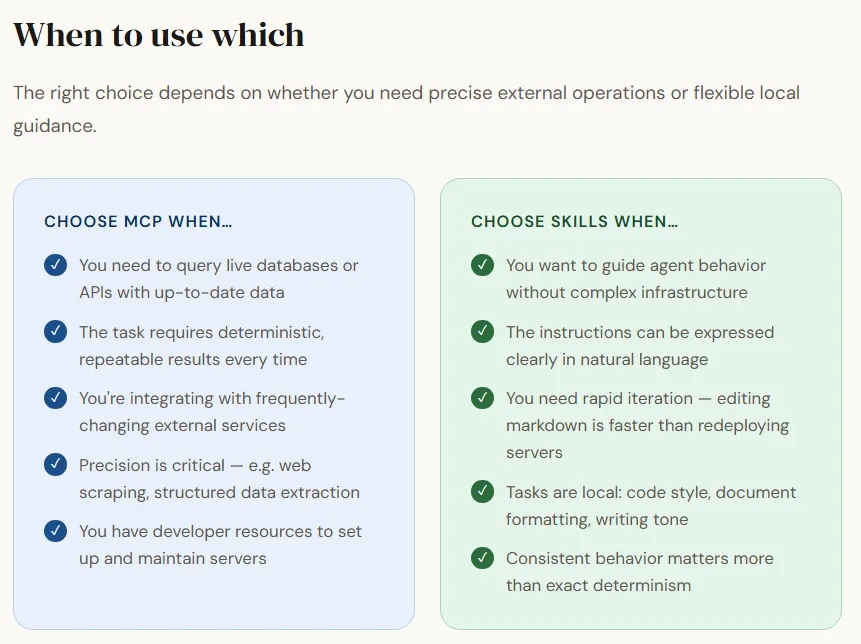

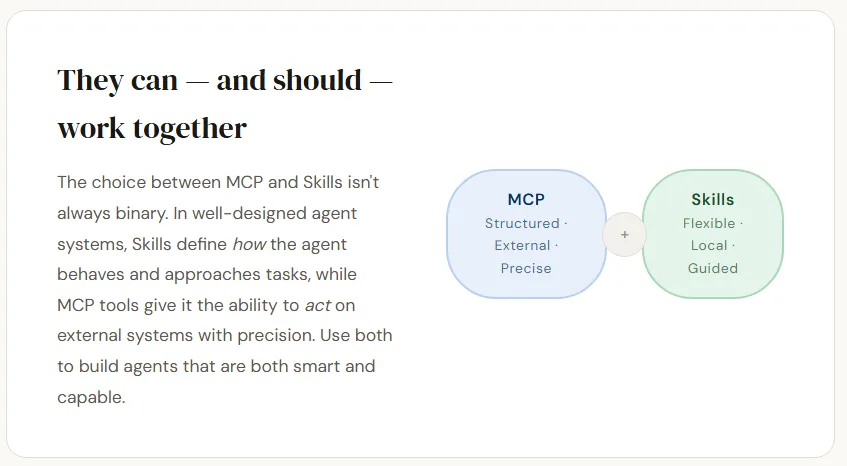

Ambas as abordagens oferecem formas de ampliar as capacidades de um agente de IA, mas diferem na forma como fornecem informações e executam tarefas. Uma abordagem depende interfaces de ferramentas estruturadasonde o agente acessa sistemas externos por meio de entradas e saídas bem definidas. Isso torna a execução mais previsível e garante que as informações sejam recuperadas de um fonte central e continuamente atualizadao que é particularmente útil quando o conhecimento subjacente ou as APIs mudam com frequência. No entanto, esta abordagem muitas vezes requer uma configuração mais técnica e introduz latência de rede, uma vez que o agente precisa de comunicar com serviços externos.

A outra abordagem concentra-se instruções comportamentais definidas localmente que orientam como o agente deve lidar com determinadas tarefas. Essas instruções são leves, fáceis de criar e podem ser personalizadas rapidamente sem infraestrutura complexa. Como são executados localmente, evitam sobrecarga de rede e são simples de manter em pequenas configurações. No entanto, como dependem de orientação em linguagem natural e não de execução estruturada, às vezes podem ser interpretados de forma diferente pelo agente, levando a resultados menos consistentes.

Em última análise, a escolha entre os dois depende em grande parte do caso de uso—se o agente precisa de operações precisas de origem externa ou de orientação comportamental flexível definida localmente.

A postagem Protocolo de contexto de modelo (MCP) vs. habilidades do agente de IA: um mergulho profundo em ferramentas estruturadas e orientação comportamental para LLMs apareceu pela primeira vez no MarkTechPost.

Deseja saber mais sobre Inteligência Artificial, Clique Aqui!